コンフォーマル予測における被覆率・長さ指標への疑問:短い区間がより良いとは限らないとき

従来のコンフォーマル予測(CP)の評価において、実際の値を含む「被覆率」と予測の精密さを示す「平均区間長」の二つの指標だけでは、手法の真の有用性や信頼性を判断するには不十分であることが本研究によって指摘されました。

TL;DR(結論)

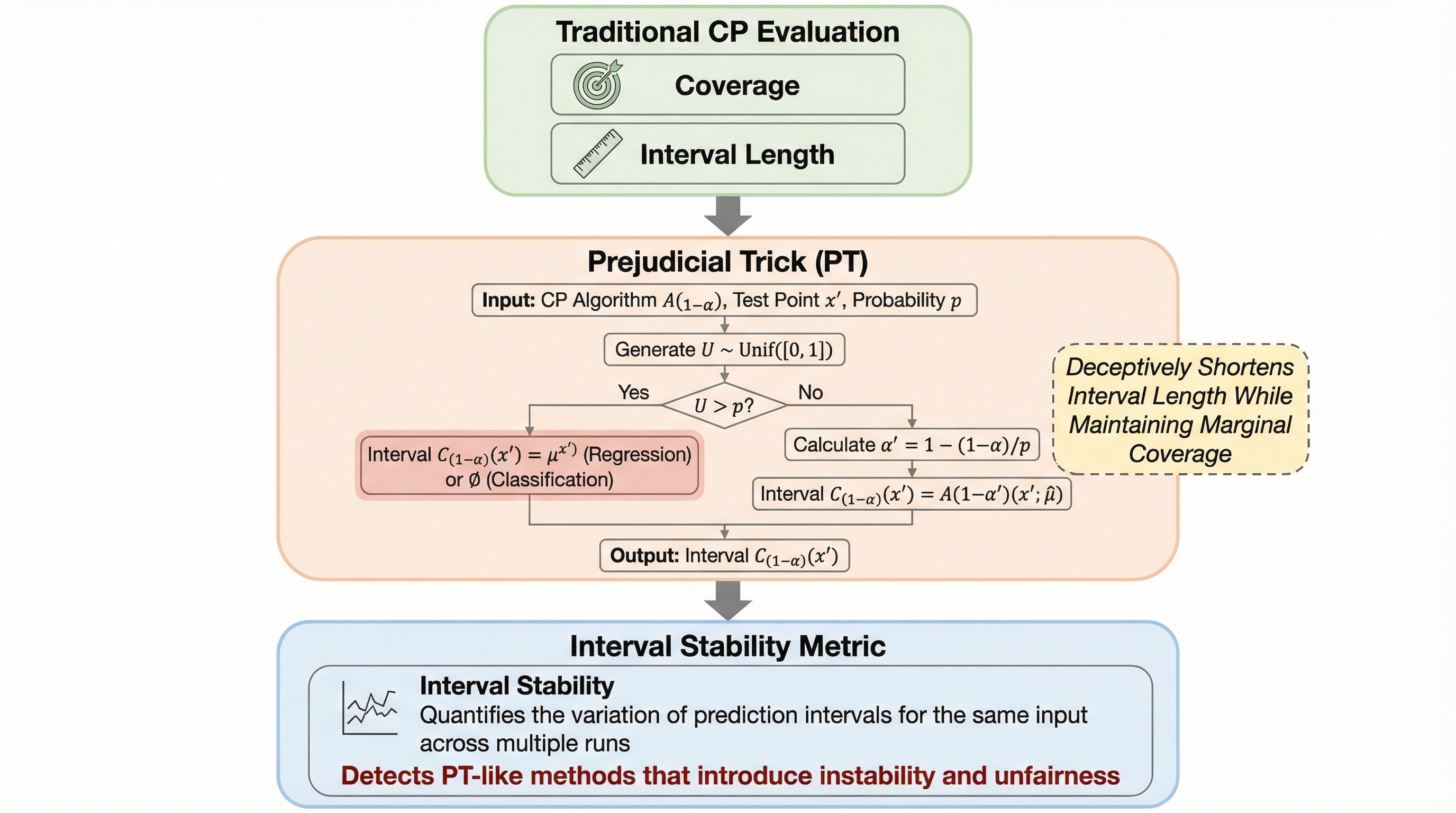

従来のコンフォーマル予測(CP)の評価において、実際の値を含む「被覆率」と予測の精密さを示す「平均区間長」の二つの指標だけでは、手法の真の有用性や信頼性を判断するには不十分であることが本研究によって指摘されました。 著者らは、数学的な被覆率の保証を厳密に維持したまま、ランダム性を利用して見かけ上の平均区間長だけを短縮する「Prejudicial Trick(PT)」という手法を提示し、数値上の改善が実用的な信頼性の欠如を隠蔽し得ることを証明しました。 このような数値上のトリックを検出し、手法が実用的な一貫性を備えているかを評価するため、同一の入力に対して繰り返し実行した際に出力がどの程度変動するかを測定する「区間安定性(Interval Stability)」という新しい評価指標の導入を提案しています。

なぜこの問題か

機械学習モデルが医療診断や金融予測といった、高い安全性が求められる重要な意思決定の現場で活用される際、モデルが自身の予測に対してどの程度の確信を持っているかという「不確実性」を正確に把握することは極めて重要です。しかし、現代の深層学習モデルなどは過剰な自信を持つ傾向があり、その予測をそのまま信頼することは危険を伴います。そこで、データの分布に依存せずに、実際の値が予測区間に含まれる確率を理論的に保証できる手法として、コンフォーマル予測(CP)が広く採用されるようになりました。 一般に、コンフォーマル予測の性能は「被覆率(実際の値が区間内に含まれる割合)」と「区間長(予測の精密さ)」の二つの指標で評価されます。研究者の間では、理論的な被覆率を維持しながら、いかにして予測区間を短くするかが主要な競争軸となってきました。区間が短いほど、予測の不確実性が小さく、より有用な情報を提供していると見なされるからです。しかし、本論文の著者らは、この「短いほど良い」という単純な評価基準に重大な疑問を投げかけています。 例えば、二人の医師が患者の回復時間を予測する場面を考えてみましょう。…

核心:何を提案したのか

本論文の核心的な提案は、従来の評価指標を「ハック」することが可能であることを示す「Prejudicial Trick(PT)」という手法の提示と、それを防ぐための新指標「区間安定性(Interval Stability)」の導入です。PTは、任意のテストサンプルに対して確率的に「空集合(分類の場合)」または「一点集合(回帰の場合)」という情報を持たない結果を返し、それ以外のサンプルに対しては、全体の被覆率を調整するために通常よりも高い信頼レベルで区間を構築するアルゴリズムです。 この手法を用いると、周辺被覆率(Marginal Coverage)という数学的な保証を厳密に守ったまま、平均的な区間長を従来の標準的な手法よりも短く見せかけることが可能になります。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related