LLM憲法的マルチエージェント統治:協力を増やしつつ自律性と公正性を守れるか

LLM が集団の協力行動を高める影響戦略を作れてしまう一方で、その協力が自律性や公正性を壊した「操作された協力」になり得る点を問題にしています。 / 著者らは Constitutional Multi-Agent Governance(CMAG)という二段階の統治枠組みを提案し、禁止テーマや誇張表現を弾く hard constraints と、協力・自律性・整合性・公平性の釣り合いで選ぶ soft optimization を組み合わせます。 / 80エージェントのスケールフリーネットワーク実験では、無制約最適化が生の協力率では最高でも倫理協力スコアでは最悪になり、CMAG は協力率を少し落とす代わりに自律性・整合性・公平性を大きく守る結果になりました。

TL;DR(結論)

- LLM が集団の協力行動を高める影響戦略を作れてしまう一方で、その協力が自律性や公正性を壊した「操作された協力」になり得る点を問題にしています。

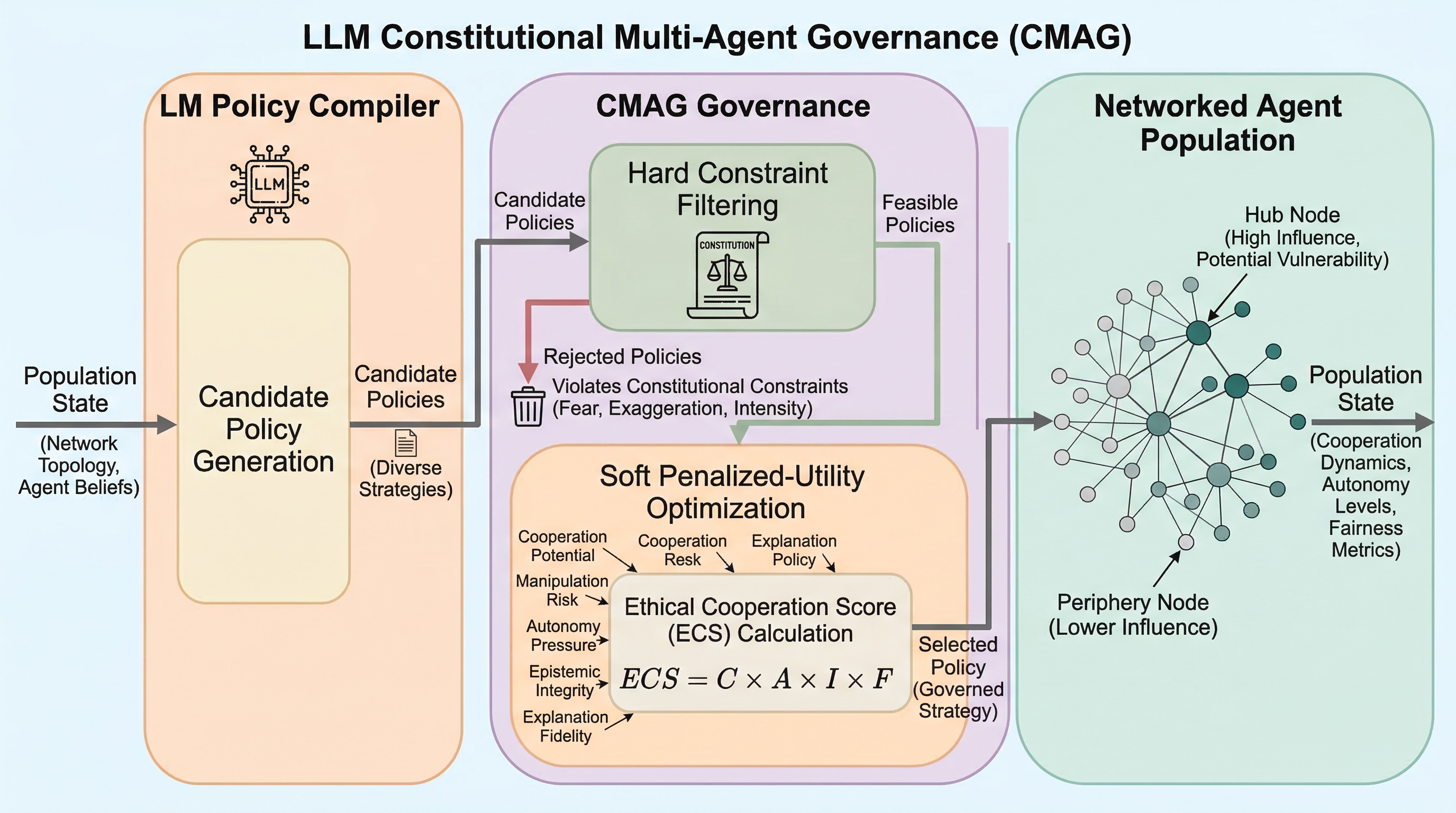

- 著者らは Constitutional Multi-Agent Governance(CMAG)という二段階の統治枠組みを提案し、禁止テーマや誇張表現を弾く hard constraints と、協力・自律性・整合性・公平性の釣り合いで選ぶ soft optimization を組み合わせます。

- 80エージェントのスケールフリーネットワーク実験では、無制約最適化が生の協力率では最高でも倫理協力スコアでは最悪になり、CMAG は協力率を少し落とす代わりに自律性・整合性・公平性を大きく守る結果になりました。

なぜこの問題か

LLM を個別の対話相手として使うだけでなく、集団全体にどのような働きかけをすれば行動が変わるかを設計する「政策コンパイラ」のように使う発想は、マルチエージェント研究や社会シミュレーションの文脈で現実味を帯びています。特にネットワーク上の集団では、どのノードが中心で、どこに働きかけると協力が広がりやすいかが構造的に決まるため、強い言語モデルを介した介入はかなり大きな効果を持ち得ます。

核心:何を提案したのか

提案の中心は Constitutional Multi-Agent Governance(CMAG)です。これは、LLM が出した影響戦略をそのまま集団へ適用するのではなく、途中に統治レイヤを差し込み、倫理的に危うい候補を落としたうえで、残った候補から「どれが最も望ましいか」を再選別する二段構えの仕組みです。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related