人手確認を前提にした手書き数学答案のLLM採点:公平性と省力化を両立させる実運用設計

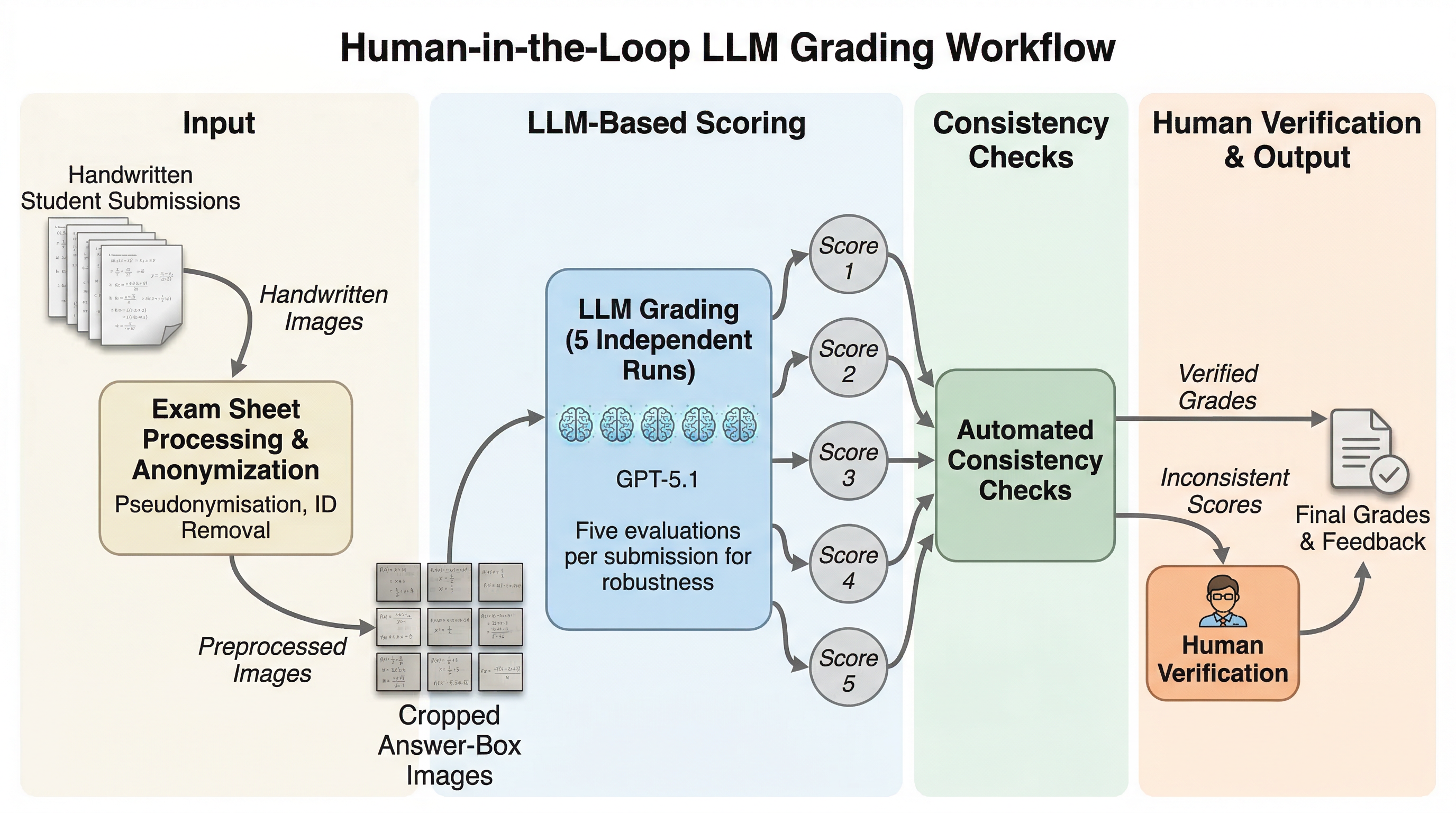

手書きの数学答案に素早く個別フィードバックを返したい一方で、在宅課題は生成AIで信頼性が落ちやすく、教室内の短い手書きテストをどう効率よく採点するかが新しい課題になっています。 著者らは、答案のスキャン、匿名化、詳細な採点基準、GPT-5.1 による5回採点、整合性確認、人間の最終確認までを一続きにした人手介在型の採点ワークフローを設計し、実際の大学数学2科目で回しました。 実験では採点時間が平均で約23.3%短縮され、人間同士の採点一致率と同等か場合によってはそれ以上の整合性が得られましたが、まれな外れ値は残るため、完全自動化ではなく人間が最後に責任を持つ設計が前提です。

TL;DR(結論)

- 手書きの数学答案に素早く個別フィードバックを返したい一方で、在宅課題は生成AIで信頼性が落ちやすく、教室内の短い手書きテストをどう効率よく採点するかが新しい課題になっています。

- 著者らは、答案のスキャン、匿名化、詳細な採点基準、GPT-5.1 による5回採点、整合性確認、人間の最終確認までを一続きにした人手介在型の採点ワークフローを設計し、実際の大学数学2科目で回しました。

- 実験では採点時間が平均で約23.3%短縮され、人間同士の採点一致率と同等か場合によってはそれ以上の整合性が得られましたが、まれな外れ値は残るため、完全自動化ではなく人間が最後に責任を持つ設計が前提です。

なぜこの問題か

学生の学習を支えるうえで、早く、具体的で、個別化されたフィードバックが重要だという話は、教育研究ではかなり一貫しています。特に小テストのような低負荷・高頻度の評価は、理解の抜けや誤解を早期に見つけ、次の学習へすぐつなげられる点で効果が大きいとされます。ところが、ここで一番面倒なのが採点です。記述式であればあるほど、採点者は途中式を読み、部分点を判断し、返却のために記録を整理しなければなりません。手書き答案はその負荷がさらに重く、クラス規模が大きいほど「本当はこまめに返したいのに、時間がなくてできない」という状況が起きます。

核心:何を提案したのか

提案の核は、手書き数学答案のための end-to-end な LLM支援採点ワークフローです。単に答案画像をモデルに投げて点数を返させるのではなく、採点の前準備から後処理まで含めた運用手順全体を設計しています。具体的には、(1) 模範解答の作成、(2) 詳細な rubric 形式の grading key の作成、(3) スキャン、OCR、匿名化、LLMによる複数回採点、整合性チェック、そして人間の最終確認、という流れです。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related