人手アノテーションなしで翻訳誤りスパン検出を鍛えられるか:反復MBR蒸留で疑似ラベルを自己生成する

機械翻訳の誤りスパン検出は、どこがどの程度おかしいかを細かく示せる重要課題ですが、人手アノテーションは高価で主観差も大きく、学習データの拡大が難しいという根本問題があります。 提案手法は、LLM 自身に多数の候補スパンを出させ、MBR 復号で最もよい候補を疑似ラベルとして選び、それを使って SFT・DPO・KTO で反復的に再学習する自己進化型の枠組みです。 WMT Metrics Shared Task で評価した結果、人手ラベルで学習した基線より system-level と span-level では上回り、sentence-level でも競争力を保ちました。特に T=2 の設定が強く、最良では SPA 0.864、SOFTF1 0.939 を記録しました。

TL;DR(結論)

- 機械翻訳の誤りスパン検出は、どこがどの程度おかしいかを細かく示せる重要課題ですが、人手アノテーションは高価で主観差も大きく、学習データの拡大が難しいという根本問題があります。

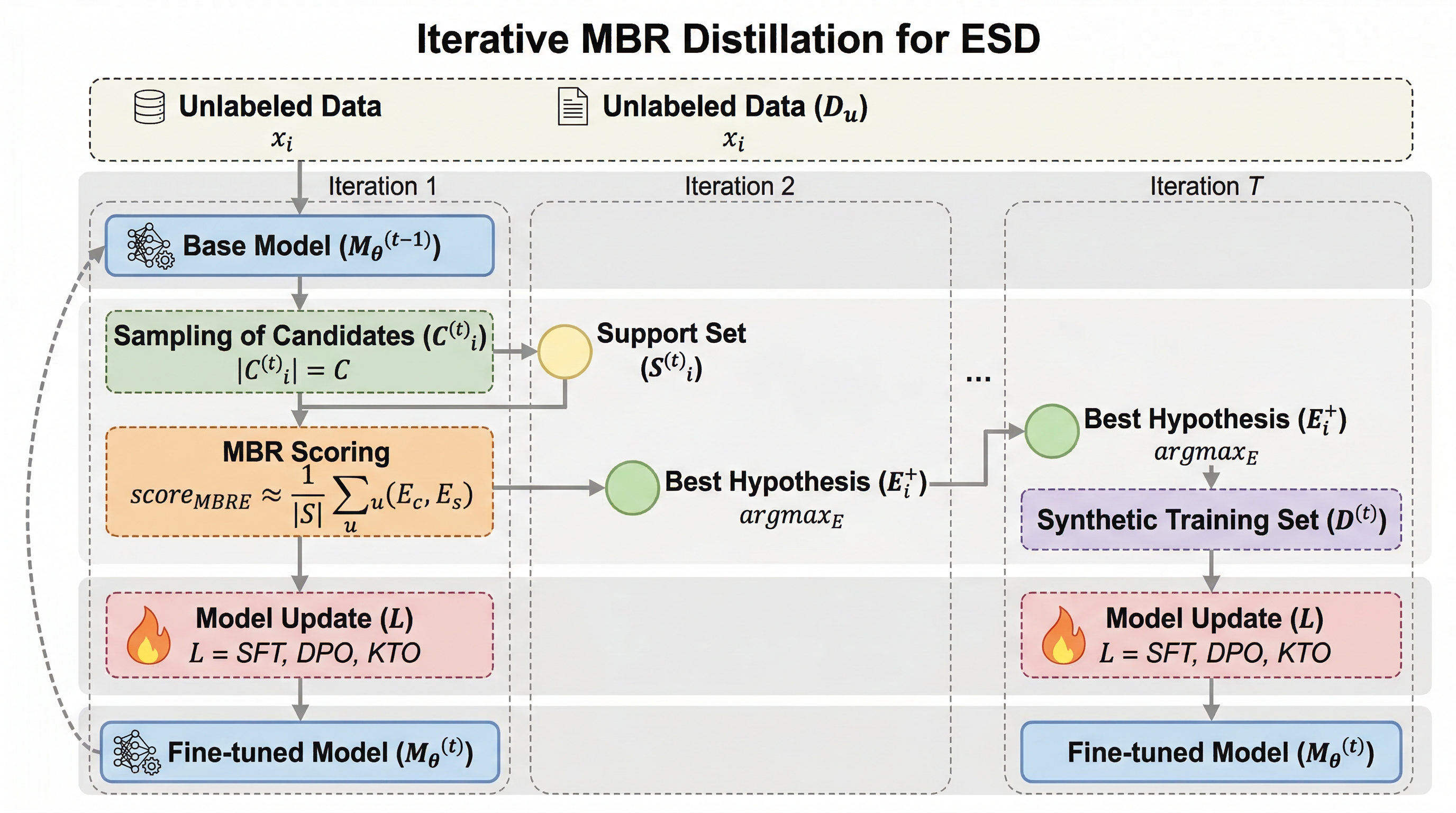

- 提案手法は、LLM 自身に多数の候補スパンを出させ、MBR 復号で最もよい候補を疑似ラベルとして選び、それを使って SFT・DPO・KTO で反復的に再学習する自己進化型の枠組みです。

- WMT Metrics Shared Task で評価した結果、人手ラベルで学習した基線より system-level と span-level では上回り、sentence-level でも競争力を保ちました。特に T=2 の設定が強く、最良では SPA 0.864、SOFTF1 0.939 を記録しました。

なぜこの問題か

機械翻訳の品質評価では、単に一文全体へ点数を付けるだけでなく、「どこに誤りがあるか」を指摘できることが重要です。Error Span Detection はその中心的な下位課題で、翻訳文のどの部分が誤りで、どれくらい深刻かを示します。これは翻訳モデルの修正、評価理由の説明、学習データの改善に直結します。

核心:何を提案したのか

提案の中心は Iterative MBR Distillation for ESD です。考え方は、モデルに未ラベルの source-translation ペアを与え、多数の誤りスパン候補を生成させ、その候補群の中から MBR 復号で最も良いものを疑似教師として選び、再学習に使うというものです。この流れを1回で終わらせず、モデル更新後にもう一度候補生成から繰り返します。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related