NAIT:命令チューニング用データを「ニューロン活性の一致」で選び直すと、少量データでも性能を底上げできる

命令チューニング用データを表面的な品質指標ではなく、モデル内部のニューロン活性パターンで選ぶ枠組み NAIT を提案しています。狙いは、特定能力を伸ばすのに本当に効くデータだけを、小さく安く選び抜くことです。

TL;DR(結論)

- 命令チューニング用データを表面的な品質指標ではなく、モデル内部のニューロン活性パターンで選ぶ枠組み NAIT を提案しています。狙いは、特定能力を伸ばすのに本当に効くデータだけを、小さく安く選び抜くことです。

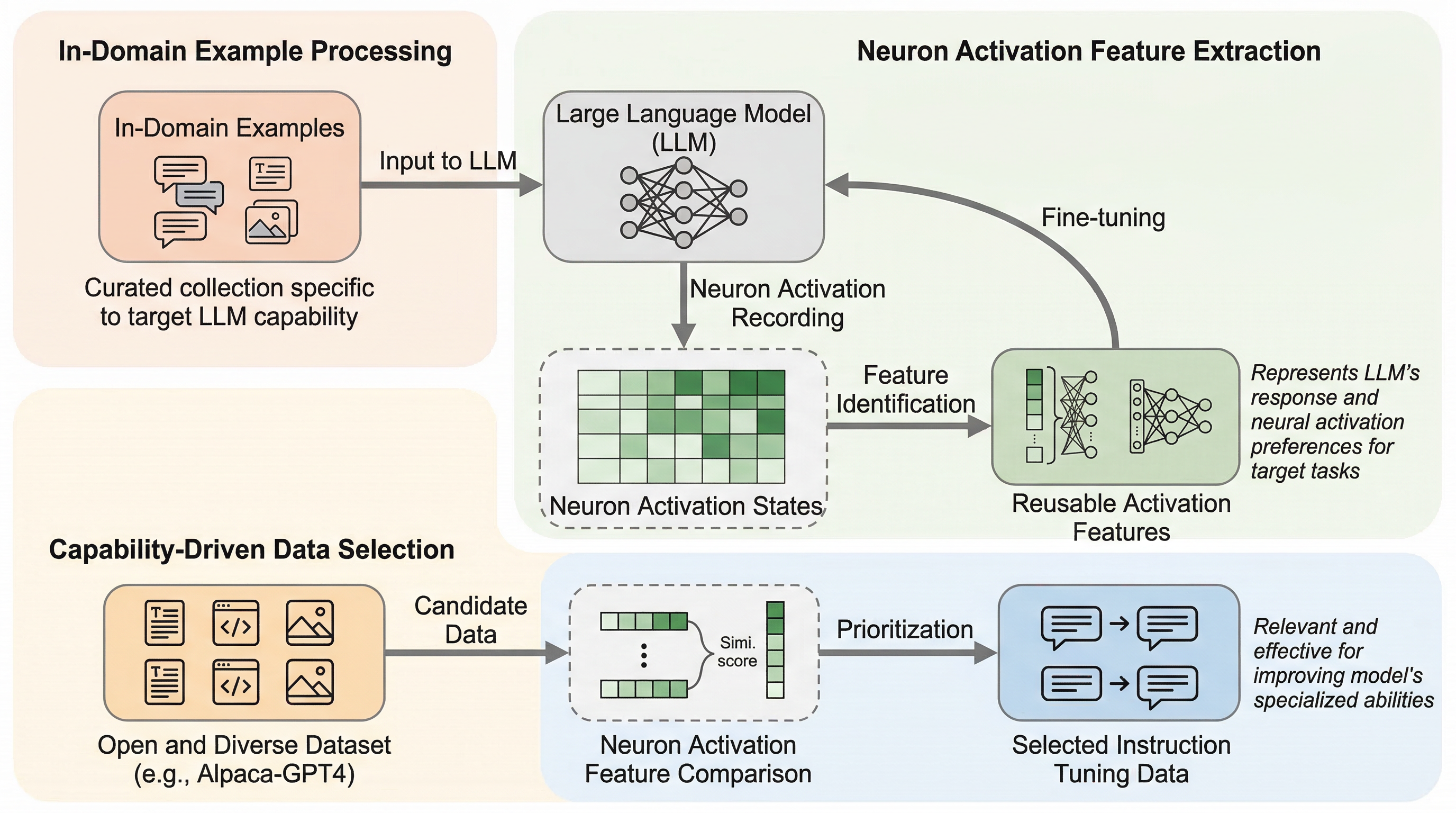

- NAIT は、対象能力の少量のインドメインデータからニューロン活性の特徴方向を抽出し、候補データがその方向とどれだけ整合するかで採点します。LLaMA-2-7B に対する実験では、Alpaca-GPT4 の 10% だけで全量学習や既存選別法を上回る平均性能を示しました。

- 面白いのは、論理推論やプログラム的特徴を持つデータが広い転移性を持ち、逆にデータを増やしすぎると性能が落ちる点です。要するに、「命令チューニングは多ければよい」ではなく、「内部活性の観点で目的に合うデータを選ぶ方が効率も性能も良い」という主張です。

なぜこの問題か

命令チューニングは、大規模言語モデルの能力を実用レベルまで引き出すための中核手法ですが、近年は「どんなデータを使うか」の方が「どれだけ大量に使うか」より重要ではないか、という流れが強くなっています。実際、少量でもよく選ばれたデータが大きな効果を持つ一方で、冗長なデータや目的に合わないデータを大量投入すると、むしろ性能を落とすことがあると報告されてきました。

核心:何を提案したのか

著者らが提案する NAIT は、Neuronal Activation-based efficient Instruction Tuning data selection framework の略で、命令チューニング用データが目標能力にどれだけ効くかを、ニューロン活性パターンの整合度で測る手法です。ポイントは、対象能力の少量のインドメインデータを通したときに現れる活性の方向をまず抽出し、それを「この能力らしさ」の特徴として再利用することです。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related