Epistemic Context Learning: LLMベースのマルチエージェントシステムにおける正しい信頼構築

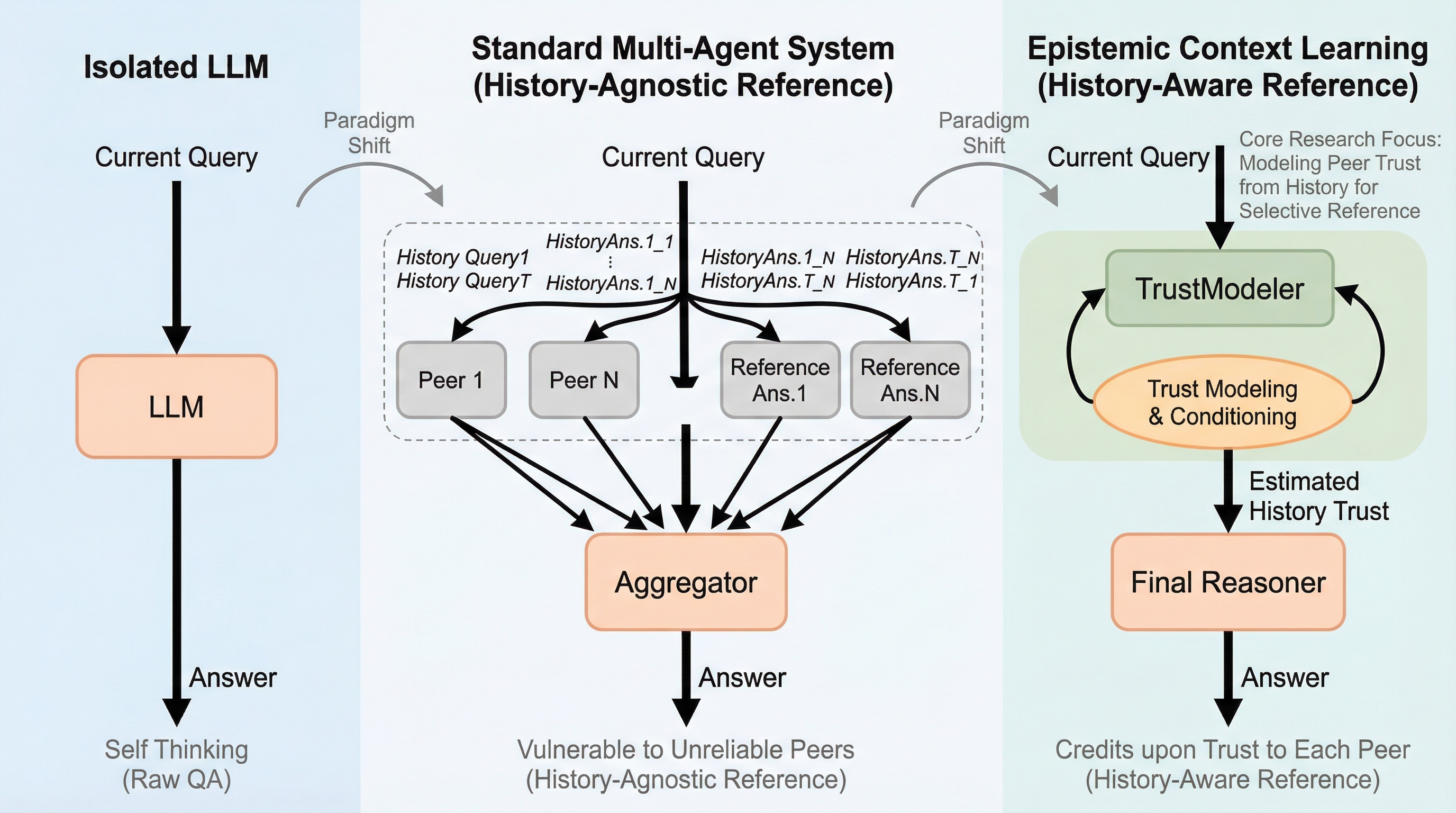

LLMベースのマルチエージェントシステムにおいて、エージェントが誤った情報を持つ他者に盲目的に同調してしまう脆弱性を解決するため、過去の対話履歴から他者の信頼性を評価して情報を選択的に参照する「履歴を考慮した参照」という新しいパラダイムを提案した。

TL;DR(結論)

LLMベースのマルチエージェントシステムにおいて、エージェントが誤った情報を持つ他者に盲目的に同調してしまう脆弱性を解決するため、過去の対話履歴から他者の信頼性を評価して情報を選択的に参照する「履歴を考慮した参照」という新しいパラダイムを提案した。 提案手法の「Epistemic Context Learning (ECL)」は、信頼性の推定と情報の統合を明示的に分離する2段階の推論フレームワークであり、補助的な報酬を用いた強化学習を組み合わせることで、小規模なモデルであっても大規模なモデルを凌駕する高い推論精度と認識的自律性を実現している。 実験の結果、ECLを導入したモデルは他者の誤情報に惑わされることなく、履歴から正確に信頼できる相手を特定して知識を統合できるようになり、数学やコード生成などの複雑な推論タスクにおいて、最先端モデルでは100%に近い極めて高い性能を達成することが確認された。

なぜこの問題か

大規模言語モデル(LLM)を用いたマルチエージェントシステムは、複雑な推論や自動化タスクにおいて大きな成功を収めているが、個々のエージェントが他者との相互作用において認識的な自律性を維持できないという深刻な課題を抱えている。先行研究では、LLMが多数派の意見に盲目的に同調する傾向や、表面上はもっともらしく見えるが実際には誤っている情報に対して非常に脆弱であることが示されている。このような脆弱性は、エージェントがノイズを適切にフィルタリングし、複雑な環境下で正確な情報を集約する能力を制限している。この問題の核心には、推論タスクの難易度とLLMが利用可能な能力との間のミスマッチが存在する。多くの場合、エージェントは自身の内部知識が不十分な状態であっても、単一の回答内容のみから他者の推論の正誤を判断することを暗黙的に要求されている。 既存のアプローチである生成報酬モデルや回答集約手法の多くは、履歴を考慮しない方法を採用しており、発信元の信頼性を考慮せずに回答そのものを評価している。…

核心:何を提案したのか

本研究では、マルチエージェントシステムにおける意思決定の進化として、過去の対話履歴を新たな入力次元として導入する「履歴を考慮した参照(history-aware reference)」というパラダイムを定式化した。これは、エージェントが現在のクエリに対する回答を生成する際、ターゲットとなるクエリと他者の回答だけでなく、それ以前に行われた複数の対話ラウンドの履歴を条件として利用するものである。このアプローチにより、エージェントは他者の過去の振る舞いから信頼性の事前分布を推定し、現在の不確実な状況において誰を信じるべきかを判断することが可能になる。このパラダイムシフトは、単なる情報の集約から、信頼に基づいた適応的な参照へとエージェントの行動を変化させるものである。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related