反復関数系としての深層ニューラルネットワークおよび汎化誤差限界

深層ニューラルネットワークを反復関数系(IFS)として捉える:安定性と汎化性能の新たな統一理論

TL;DR(結論)

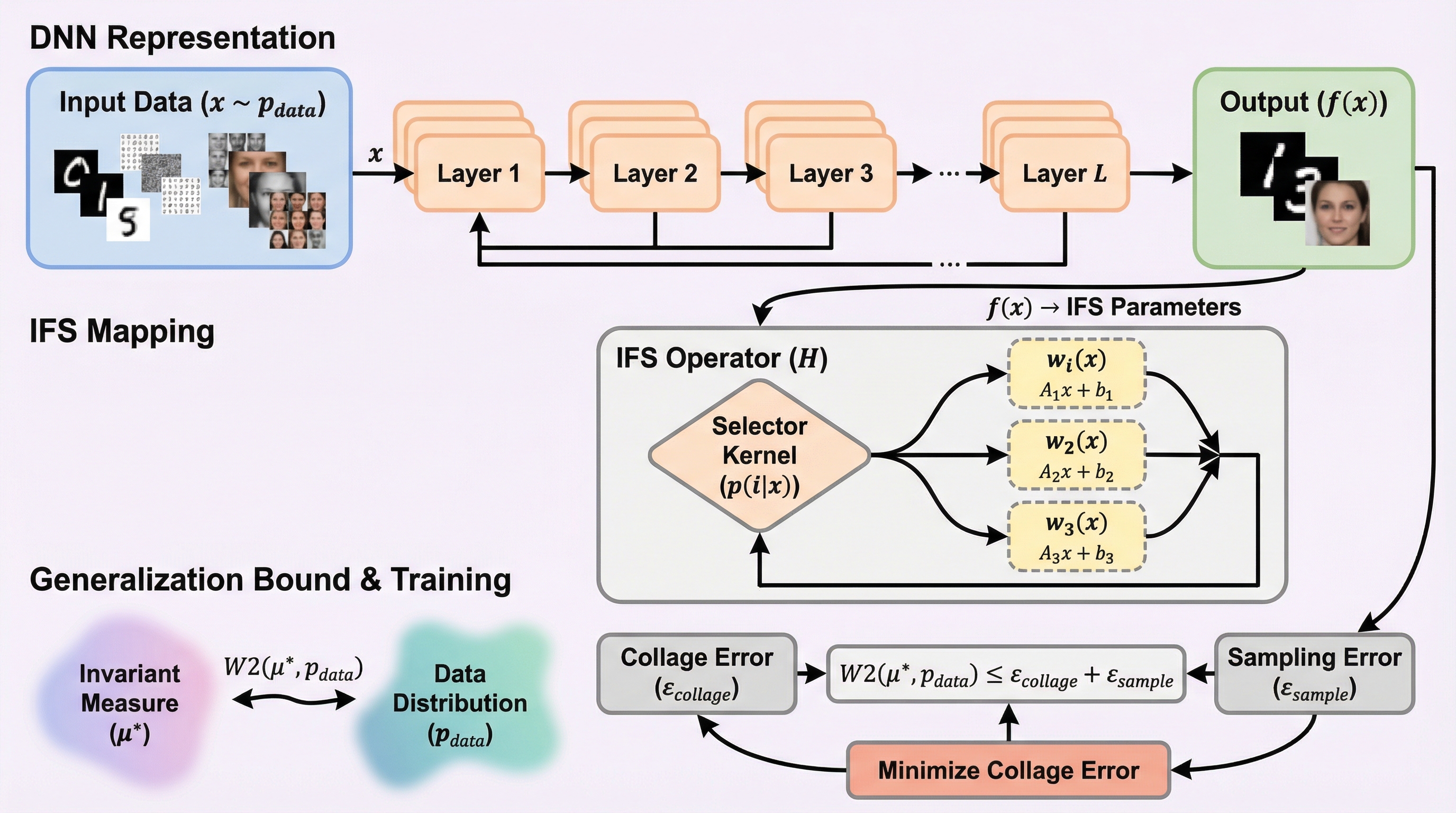

深層学習モデル(ResNetやTransformerなど)を、数学的な「反復関数系(IFS)」として再定義することで、モデルの安定性と汎化性能を統一的に解析する新しい枠組みを提案している。 モデルの深さ方向の挙動を確率的な動的システムと見なし、特定の収縮条件を満たす場合に一意の不変測度(アトラクタ)が存在することを証明し、生成モデルにおけるワッサースタイン距離を用いた汎化誤差の限界を導出した。 この理論に基づき、従来のGANや拡散モデルのような複雑な学習手法を用いず、データの分布とモデルによる変換後の分布の差を直接制御する「コラージュ誤差」を最小化する新しい学習目的関数を提案し、画像データセットでその有効性を確認した。

なぜこの問題か

現代の深層ニューラルネットワーク(DNN)は、高次元の予測や生成タスクにおいて驚異的な性能を発揮しているが、その数学的な解析は依然として断片的な状態にある。 特に、モデルの安定性と汎化性能は、通常、異なる枠組みで個別に研究されており、ケースバイケースの対応に留まっているのが現状である。 アーキテクチャの観点から見ると、DNNはパラメータ化された関数の再帰的な適用に依存しているが、このメカニズムは不安定になりやすく、学習が困難になる可能性があるため、安定性の確保が主要な課題となっている。 学習が成功した場合であっても、特に生成モデルの設定において、観測されたデータを超えてモデルがどの程度うまく汎化するかについての厳密な結果はほとんど存在しない。 既存の生成モデルである拡散モデルやスコアベースモデルは、反復的なデノイジングネットワークに依存しており、サンプリング速度が遅いという課題を抱えている。 また、GAN(敵対的生成ネットワーク)は学習が不安定でモード崩壊を起こしやすく、VAE(変分オートエンコーダー)は高周波成分がぼやける傾向がある。…

核心:何を提案したのか

本論文では、確率的な反復関数系(IFS)およびランダム動的システムの理論を活用し、主要な深層学習アーキテクチャを「場所依存の反復関数系(P-IFS)」として解釈する手法を提案している。 この接続により、ランダム動的システムの分野で培われた成果を深層学習に導入することが可能になり、適切な収縮性の仮定の下で不変測度の存在と一意性を確立できる。 具体的には、ResNet、Transformer、およびMixture-of-Experts(MoE)レイヤーの分岐写像とセレクターカーネルを明示化することで、これらを統一的なIFSの枠組みで記述した。 さらに、生成モデリングにおけるワッサースタイン距離を用いた汎化誤差限界を導出し、モデルの不変法則とデータ分布の間の距離が、経験的な「コラージュ誤差」と統計的なサンプリング項によって制御されることを示した。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related