CRYSTAL:最終回答だけでは見えないマルチモーダル推論の中身を、途中ステップごとに診断するベンチマーク

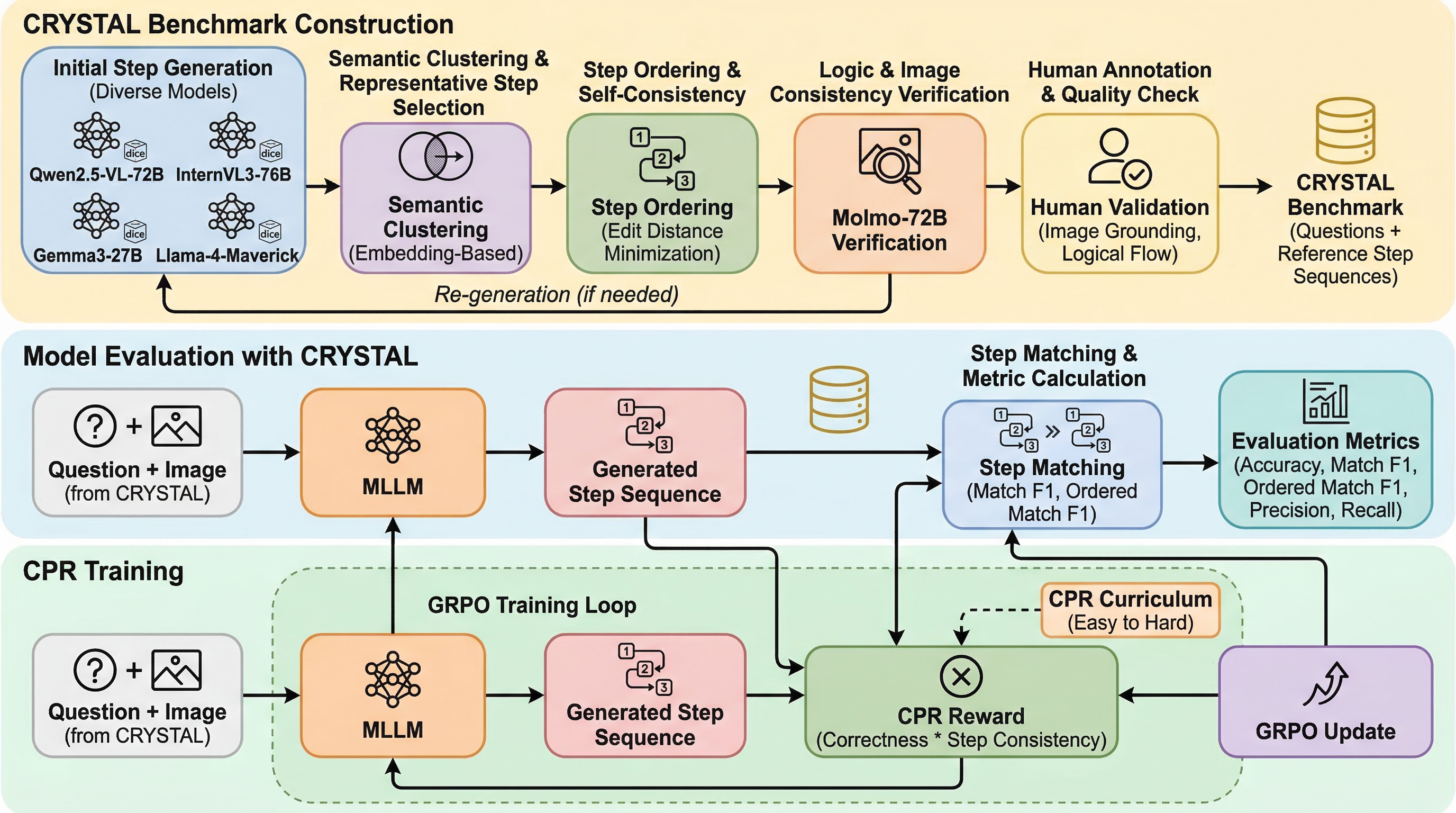

最終回答だけを見る既存評価では、たまたま当たった「ラッキー正解」と、本当に筋の通った推論を区別できません。 CRYSTAL は、画像と言語をまたぐ推論を途中ステップ単位で評価する 6,372 問のベンチマークで、Match F1 と Ordered Match F1 により「何をどこまで合っているか」「順序まで妥当か」を測ります。 20種類のモデル評価では、精度では見えない cherry-picking や順序崩れが広く確認され、さらに CPR と CPR-Curriculum により、手作業の中間注釈なしでも推論品質を改善できる可能性が示されています。

TL;DR(結論)

- 最終回答だけを見る既存評価では、たまたま当たった「ラッキー正解」と、本当に筋の通った推論を区別できません。

- CRYSTAL は、画像と言語をまたぐ推論を途中ステップ単位で評価する 6,372 問のベンチマークで、Match F1 と Ordered Match F1 により「何をどこまで合っているか」「順序まで妥当か」を測ります。

- 20種類のモデル評価では、精度では見えない cherry-picking や順序崩れが広く確認され、さらに CPR と CPR-Curriculum により、手作業の中間注釈なしでも推論品質を改善できる可能性が示されています。

なぜこの問題か

マルチモーダル大規模言語モデルは、画像理解、数理推論、空間判断、表読み取りといった多様なベンチマークで高い正答率を出しています。しかし、従来の多くのベンチマークは最終回答だけで採点します。そうすると、答えが合っているかどうかは分かっても、その答えに至る途中の認識や推論が正しかったかは見えません。結果として、偶然の当たりや、画像内の一部だけを都合よく拾った近道が、正しい理解と同じ点数で扱われてしまいます。

核心:何を提案したのか

提案の中心は CRYSTAL です。正式には Clear Reasoning via Yielded Steps, Traceability and Logic の略で、マルチモーダル推論を「途中ステップ込み」で診断するベンチマークです。各問題には、単なる正解ラベルではなく、そこへ到達するために必要な自然言語の参照推論ステップ列が付いています。モデルの出力した推論も同じ粒度で比較し、どのステップが合っているか、どのステップが抜けているか、順序が崩れていないかを機械的に採点します。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related