ARL-Tangram:エージェント型強化学習の外部資源を「行動単位」でさばく資源管理基盤

エージェント型強化学習では、GPUだけでなくCPU、報酬モデルGPU、API枠、検索やコード実行環境など外部資源の使い方が学習効率を大きく左右しますが、従来は軌跡単位・タスク単位の静的な過剰確保が多く、無駄が大きい状態でした。 ARL-Tangramは、外部資源呼び出しを action-level、つまり個々の原子的な操作単位へ分解し、資源要求を統一表現したうえで、弾力的に再配分する資源管理システムです。 実タスク評価では、平均ACTを最大4.3倍改善し、学習ステップ時間を最大1.5倍短縮し、外部資源コストを最大71.2%削減しました。MiMo 系モデルの学習にも実際に投入されています。

TL;DR(結論)

- エージェント型強化学習では、GPUだけでなくCPU、報酬モデルGPU、API枠、検索やコード実行環境など外部資源の使い方が学習効率を大きく左右しますが、従来は軌跡単位・タスク単位の静的な過剰確保が多く、無駄が大きい状態でした。

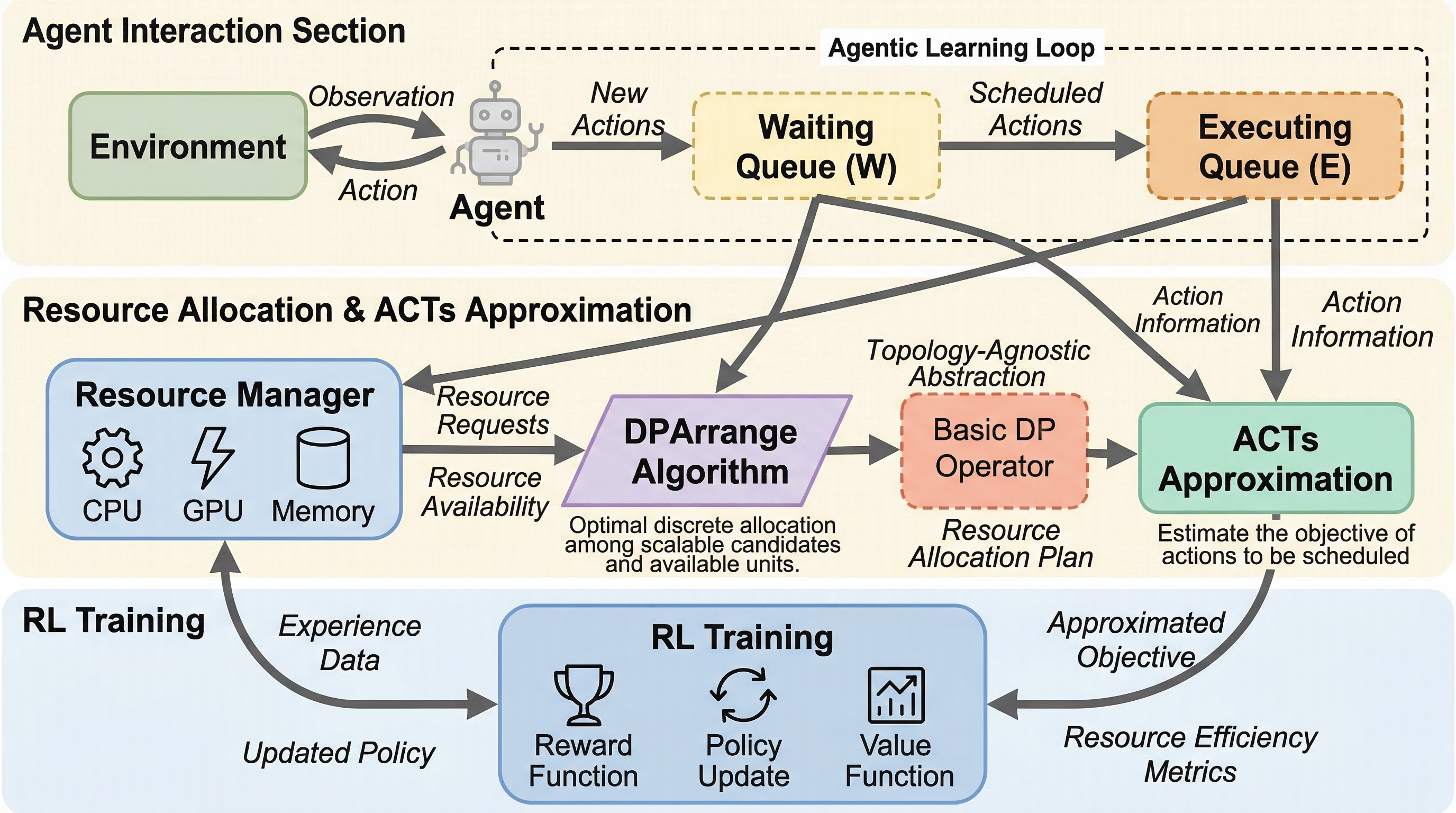

- ARL-Tangramは、外部資源呼び出しを action-level、つまり個々の原子的な操作単位へ分解し、資源要求を統一表現したうえで、弾力的に再配分する資源管理システムです。

- 実タスク評価では、平均ACTを最大4.3倍改善し、学習ステップ時間を最大1.5倍短縮し、外部資源コストを最大71.2%削減しました。MiMo 系モデルの学習にも実際に投入されています。

なぜこの問題か

エージェント型強化学習では、モデル本体の学習だけ見ていても全体性能は上がりません。AI coding ならコード実行用CPUやテスト環境、DeepSearch なら複数APIやウェブアクセス枠、MOPD のような設定なら teacher model や reward service 用GPUが必要になります。しかもこれらは学習クラスターの外側にあり、LLM本体のGPUとは別の管理問題を持っています。

核心:何を提案したのか

中心提案は ARL-Tangram です。名前の通り、ばらばらな外部資源呼び出しを細かいパーツに分け、それを組み替えて全体効率を上げる発想です。軌跡やタスク全体を単位に資源を握らせるのではなく、atomic な action 単位へ細かく分解し、その action だけが必要な間だけ資源を持ち、終わればすぐ返す形へ変えます。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related